Il business degli assistenti vocali: una corsa ad handicap per i gruppi auto

Hyundai porterà un nuovo assistente vocale al CES 2018 e lo stesso farà Bosch: ma è molto il terreno da recuperare ai leader come Alexa di Amazon

Al CES di Las Vegas, che aprirà oggi con alcune delle conferenze più attese, anche nel 2018 come già lo scorso anno gli assistenti virtuali con controlli vocali saranno protagonisti. Google apparentemente è intenzionata a prendersi una rivincita su Amazon. Quest’ultima oggi con la sua Alexa, nata nel 2014 da brevetti di due anni prima, è la protagonista di questo mercato.

Si tratta di un settore in cui le case automobilistiche o comunque legate all’automotive cercano a loro volta di sgomitare. Nei padiglioni della fiera del Nevada Hyundai porterà il suo Intelligent Personal Agent. Sviluppato insieme a SoundHound a partire dal sistema Houndify, anche questo nuovo maggiordomo sintetico sarà sviluppato grazie ad un ruolo preminente dei sistemi di intelligenza artificiale.

I coreani, quinto gruppo auto globale, si segnalano per l’intenzione di portare il nuovo assistente vocale su tutti i modelli entro il 2019: se il dispositivo per ora sarà testato su prototipi, inclusi quelli spinti da idrogeno, Hyundai vuole che questi prodotti non siano riservati a modelli e versioni al top della gamma.

I coreani sono sempre stati molto attenti alle possibilità degli assistenti virtuali in passato. In Europa, dove ancora non sono entrati in modo capillare, siamo abituati a vedere sui modelli asiatici l’infotainment basato sul TomTom Live. Ma in America, dove sulle Hyundai più recenti è installato un dispositivo chiamato Blue Link, questa app già nel 2016 era predisposta per Alexa, e nel 2017 è diventata compatibile col Google Assistant.

Pochi gruppi hanno oscillato in breve tempo come Hyundai tra tre assistenti virtuali concorrenti: ma questo forse è solo il caso più evidente di un timore che si sta diffondendo nel mondo dell’auto: che questi dispositivi diventino un fattore decisivo per gli acquisti mettendo in ombra anche i brand.

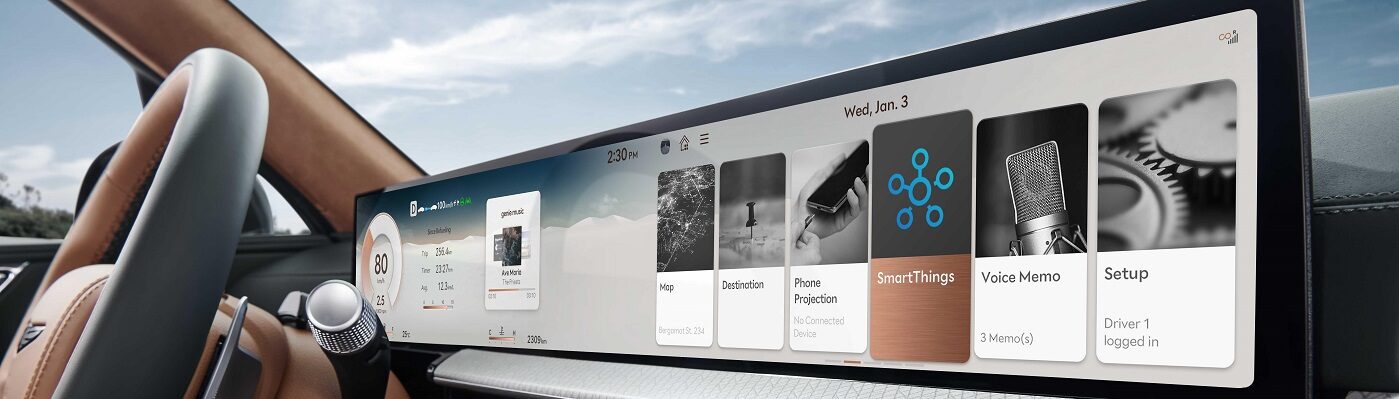

Il fatto che anche un colosso della fornitura come Bosch abbia deciso di presentare un assistente vocale al CES 2018 pare indicare che questo settore sia preso sempre più sul serio. Per quanto un maggiordomo da cockpit possa apparire oggi una curiosità o anche un lusso, si tratta in effetti di quello che domani si rivelerà il baricentro dei comandi vocali. E sarà importante.

Perché? Come ha scritto Russ Mitchell del Los Angeles Times in una disamina dello stato dei controlli vocali applicata all’auto, per le case auto “i controlli vocali sono una minaccia più esistenziale perché l’utilizzo, portato alle sue estreme conseguenze, permetterebbe al guidatore di controllare tutto in auto mediante un assistente virtuale connesso alla rete“.

E tuttavia per i protagonisti dell’automobile, case o fornitori che siano, il tentativo di farsi largo autonomamente nel settore degli assistenti virtuali è una corsa tutta in salita. Per tre tipi di ragioni che si possono riassumere in tre parole: posizionamento, dati ed app.

L’assistente vocale delle case della tecnologia ha su quelli nati in auto vantaggi nel posizionarsi, nel raccogliere e filtrare i dati e nell’interesse degli sviluppatori

Gli assistenti virtuali più diffusi come Alexa e Cortana, sono diventati pervasivi in America affermandosi a partire delle abitazioni. All’inizio hanno suscitato perplessità ma poi, come gli smartphone venuti prima di loro, hanno iniziato a modificare le abitudini. In questo certo aiutati dal fatto di essere posizionati nello spazio domestico: ovvero dove chi li usa è più a proprio agio.

Per quanto alcuni abbiano perfino tentato di convincerci che l’auto entrerà in casa letteralmente (come ha proposto Renault col suo concept Symbioz), in realtà è molto più avvantaggiato un sistema che dall’abitazione debba estendersi allo spazio dell’auto durante le ore spese da pendolare o da viaggiatore piuttosto che il contrario. Se in una abitazione si tenderà ad appoggiarsi spesso ad Alexa o Cortana i clienti cominceranno ad aspettarsi di trovarla in auto.

Alcuni, come General Motors insieme ad IBM, stanno cercando di aprire spazi di shopping sfruttando il tempo elevato trascorso al volante. Anche se dovesse avere successo sembra molto difficile che un cliente GM abbia voglia di alzarsi dal soggiorno per andare in auto a comprare o ordinare qualcosa che può fare più comodamente seduto in poltrona.

I controlli vocali, come gli smartphone, sono insomma avvantaggiati rispetto ad un sistema nato in automobile perché in grado di fare più cose. E questa capacità porta al secondo vantaggio dei sistemi di Amazon, Google & C. rispetto a quelli sviluppati a partire dall’automobile: quello dei dati.

Questo ha due aspetti. Anzitutto la raccolta stessa dei dati. George Anders in un articolo per la MIT Technology Review sottolineava come i vari Echo, Dot e concorrenti “possono spegnere le luci, dire barzellette o lasciarti leggere le notizie con le mani libere. E anche raccolgono messe di dati su chi li usa, che vengono impiegati per migliorare Alexa e aggiungere ulteriori funzioni”.

I dati determinanti per il successo di ogni progetto basato su sistemi di machine learning perché hanno valenza sia quantitativa che qualitativa. Come il volume di dati raccolti possa aiutare è già intuitivo: più sono le informazioni precise su abitudini, spostamenti ed acquisti nel periodo di Natale, per esempio, e maggiore sarà la capacità di rispondere alla domanda in modo efficiente.

L’aspetto qualitativo del volume di dati è meno ovvio. La messa a punto della programmazione basata sulle reti neurali, iniziata a partire dal 2012 con ricerche sulla classificazione di immagini, è stata possibile solo quando il volume di dati a disposizione, nello specifico immagini digitali in rete, è diventato smisurato.

Quello che Alex Krizhevsky, dottorando di Geoffrey Hinton all’università di Toronto, per primo ha fatto è stato far “digerire” agli algoritmi sempre più immagini. Fino a portare il programma al punto in cui è stato in grado di classificare (o più esattamente indicare con una probabilità sempre più vicina al 100%) che in una foto ci fosse un gatto, un cane, un fiore.

Più è smisurata la mole dei dati che i programmi di intelligenza artificiale hanno a disposizione e maggiore sarà la precisione e l’efficienza con cui i dispositivi basati sui controlli vocali risponderanno. Quello che vale nel riconoscimento di immagini vale anche nel riconoscimento di suoni o nell’analizzare frasi.

Rohit Prasad, che guida lo sviluppo di Alexa, alla MIT Technology Review ha detto l’anno scorso: “La chiave è lavorare attraverso grandi masse di dati degli utilizzatori ed imparare dagli errori. Più tempo Alexa passa con chi la usa, più dati raccoglie dai quali imparare, e più abile diventa“.

Alexa, Siri e Cortana rispetto agli assistenti personali proposti da case automobilistiche come Hyundai o Nio godono già del vantaggio di miliardi di minuti di registrazioni e frasi passate al setaccio dalle reti neurali degli ingegneri addetti allo sviluppo dei sistemi. Uno svantaggio che, fino a quando a fare da pilastro al settore sarà l’intelligenza artificiale come la conosciamo ora non sarà facile colmare.

C’è anche un terzo motivo per cui Amazon, Apple & C. hanno un vantaggio quasi sfacciato sul versante dei dispositivi basati sui comandi vocali. E inizia a partire da quello che conosciamo come network effect. Nei social media, ad esempio, tendiamo a seguire solo quelle app che anche altre persone della nostra rete sociale impiega. Una bella app, se nessuno dei nostri amici o colleghi di lavoro la utilizza, viene presto messa da parte.

Per Alexa decine di sviluppatori sono al lavoro per aggiungere nuove funzionalità. In alcuni casi sono banali cose quotidiane: come il comando per, sì, far tirare lo sciacquone in bagno. Ma sempre più spesso scopriamo che le capacità si estendono anche ad attività più complesse: la rete di stazioni di ricarica ChargePoint ha appena aggiunto l’integrazione delle sue colonnine per le auto elettriche con l’assistente vocale di Amazon.

Appena diventerà chiaro quale tra i vari rivali di Echo e Dot sia la scelta alternativa è probabile che si innescherà un meccanismo altrettanto vivace per Cortana, Google Assistant o, chissà, un outsider. Ma, per i due motivi che abbiamo già elencato, non è immaginabile che tanti si gettino a pesce su un assistente vocale che nasce in automobile.

Magari Hyundai insieme a Sound Hound, oppure Bosch per il suo assistente virtuale Casey, riusciranno inizialmente a convincere sviluppatori a creare nuove funzionalità da aggiungere ai concorrenti dei dispositivi nati per uso domestico. Ma se a breve termine i download delle nuove app non saranno vivaci i maggiordomi nati in auto rischieranno di restare privi di sviluppo.

Un fenomeno già visto negli smartphone, con lo scarso interesse dei programmatori per creare app per quel sistema operativo Windows Mobile che non ha mai decollato veramente o con il rapido declino di applicazioni compatibili coi BlackBerry, man mano che i telefoni della azienda canadese passavano di moda.