Le prime norme etiche per le auto sono su misura per gli esseri umani

La Commissione Etica per la Guida Autonoma insediata in Germania ha stilato delle linee guida che non delegano le scelte ai software

Dall’autunno del 2016 in Germania la Commissione Etica per la Guida Autonoma presieduta dall’ex-giudice costituzionale Udo Di Fabio ha lavorato sostanzialmente per rispondere ad una domanda: quali decisioni dovrebbe essere consentito di prendere alle macchine e come gestirne le conseguenze?

Una certezza legale riconosciuta per la tecnologia della guida autonoma è indispensabile per non affondare il potenziale di un settore che richiede enormi investimenti e che costituisce una delle due principali svolte della mobilità in questo secolo. Che proprio il paese che ha nell’automobile il pilastro della sua manifattura voglia certezze in merito è tutto tranne che sorprendente.

Ma non è solo attenzione ai livelli del PIL tedesco ad avere messo fretta alla commissione: i partecipanti hanno riconosciuto il valore dello sviluppo dei sistemi di guida autonoma per aumentare il livello di sicurezza del traffico.

Dopo aver provato per la prima volta un viaggio con un veicolo autonomo sull’autostrada A9 in Baviera, il giudice Di Fabio ha detto: “sono convinto che tra vent’anni il traffico non causerà più oltre 3.000 incidenti mortali l’anno“.

Ma esiti fatali hanno messo alla prova il lavoro della dozzina di scienziati, giuristi, esperti anche dove presenti solo come eventualità. Come quando si sono trovati inevitabilmente a sviscerare il noto dilemma del trolley: la scelta in caso di incidente dalle estreme conseguenze estreme di chi coinvolgere.

Per le decisioni degli esseri umani in questi, per fortuna, casi circoscritti quello che scarseggia è il tempo. Ma così non è per i processori di cui sono farciti i sistemi di guida autonoma: GPU, CPU, FPGA in grado di calcolare con rapidità non umana. Ma gli algoritmi che girano sui sistemi di guida autonoma devono essere approntati prima dell’evento.

Sebbene il giudice Di Fabio ammetta che quelle stilate dalla commissione siano linee guida adatte ad essere fondamenta di ulteriori normative nazionali ed internazionali (al quotidiano Suddeutsche Zeitung ha detto: “non scendiamo dal Monte Sinai coi comandamenti definitivi“), loro hanno dato una risposta.

Le vite di esseri umani non dovrebbero essere valutate e soppesate l’una contro l’altra. Ovvero, per chi programma il codice dei sistemi di guida autonoma, non si può programmare la scelta tra vita uno e vita due o tre. Un esito che la commissione vede come conforme sia alla Dichiarazione Universale dei Diritti dell’Uomo che ha quanto scritto nella costituzione della Repubblica Federale.

Si tratta di una delle quindici indicazioni fornite dalla commissione per progettare sistemi autonomi. Non diversamente dalle tre leggi della robotica rese celebri dallo scrittore Isaac Asimov, la macchina deve mettere al primo posto nella sua scala dei valori l’uomo. Le norme hanno come bussola la riduzione ai minimi termini dei danni agli esseri umani; la programmazione dovrebbe quindi avere carattere conservativo per anticipare i possibili pericoli.

La programmazione deve quindi prevenire infortuni o peggio ad esseri umani dando ad essi priorità rispetto a danni a cose o animali se questo evita danni a passeggeri o pedoni. I programmi di apprendimento automatico e di intelligenza artificiale dovrebbero quindi includere queste norme, che essi potranno includere come parametri ,filtri o contrappesi.

Quando la commissione era stata insediata, a ottobre 2016, il fisico Armin Grunwald aveva dichiarato al collega Mirko Heinemann di vedere l’iniziativa dello sviluppo di un’etica sui sistemi dei veicoli autonomi come un primo passo verso la futura uguaglianza uomo-macchina.

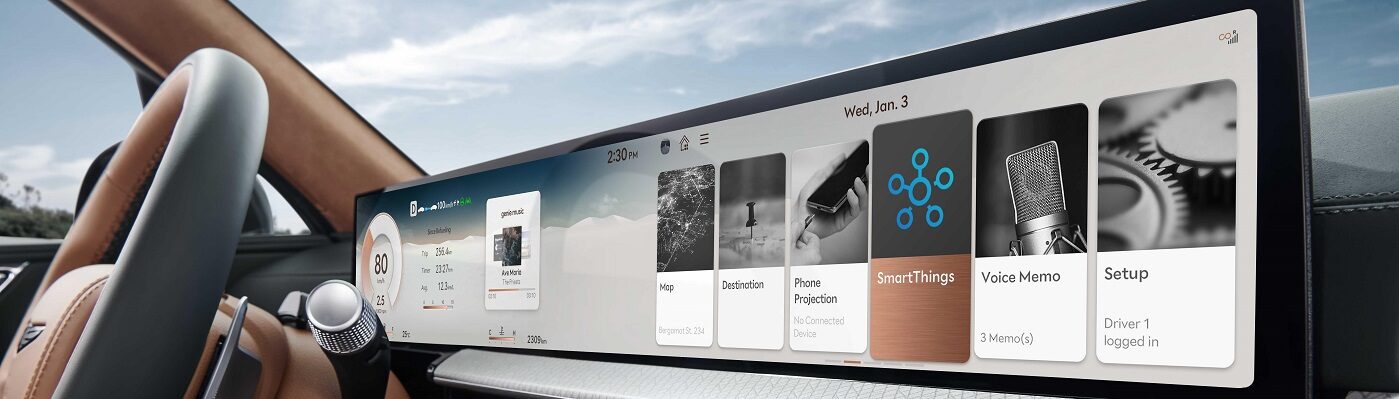

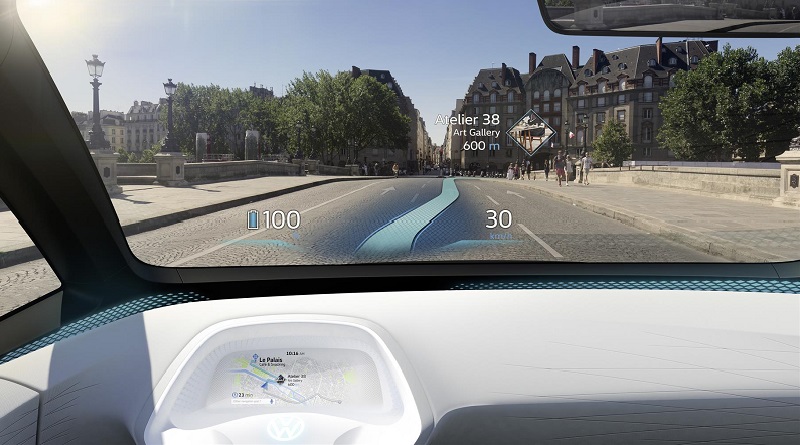

La commissione sembra anche fare chiarezza sui dubbi che hanno avvolto il tema della responsabilità in caso di incidente. Il proprietario è responsabile solo se l’auto la controlla personalmente. A partire da quando (come si vede nella foto di apertura del concept Volkswagen I.D.) il volante rientra nel cruscotto il responsabile è il produttore del veicolo.

Un approccio che già è stato fatto proprio anche da case automobilistiche. Volvo, ad esempio, non ha fatto mistero che da quando il programma sperimentale Drive Me lascerà il posto a veicoli pienamente autonomi destinati al pubblico si assumerà la responsabilità di eventuali incidenti avvenuti quando i sistemi di bordo hanno il controllo della marcia.

Dove non sono le aziende a chiarire la propria posizione, qualcun altro può decidere di farlo al loro posto. Lo scorso anno l’agenzia americana del traffico NHTSA ha mandato una lettera alla direzione del progetto della Google-car indicando che l’autorità aveva in mente di considerare un guidatore il sistema di intelligenza artificiale che controlla le auto sperimentali.

Riscrivere regole nazionali ed internazionali, per inglobare norme che coniughino etica e codice di programmazione, non sarà facile né veloce. Da poco l’agenzia Bloomberg ha riferito le dimensioni del cimento che attende chi dovrà aggiornare norme americane risalenti agli anni ’60: almeno 900 pagine da riscrivere, suddivise tra normative di differenti autorità federali.